阿里云持续创新云关键技术,做深基础 原创

云计算正在悄然改变IT行业的格局。近年来,我们可以看到一个非常明显的产业趋势:在AWS、Azure、谷歌、阿里云等云服务大厂的推动下,从芯片到服务器、存储、网络以及上层的中间件到应用,正在悄然发生变化,出现了一批为云原生的产品和技术。正如阿里云总裁张建锋大会主题演讲中所说,新型计算体系结构正在形成。

具体而言,在今年的云栖大会上,阿里不仅发布倚天710 Arm芯片,还推出了神龙4.0、磐久服务器、龙蜥操作系统以及新一代AI和数据库产品。这些产品的推出,让阿里云新一代云原生基础架构逐渐完善,进而也让阿里云能够给客户交付性能更好、更易用、更稳定、更安全的云服务。

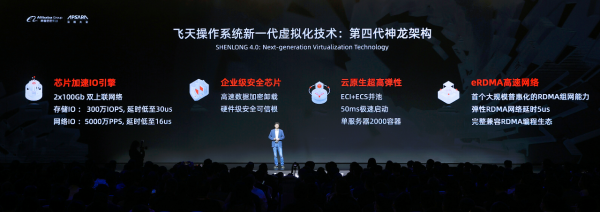

阿里云的神龙架构是阿里云的明星产品之一,从2017年正式推出以来,一直在持续不断迭代。在今年的云栖大会上,阿里云宣布推出第四代神龙架构,首次搭载了大规模弹性RDMA加速网络,网络延迟整体降低80%以上。相比传统TCP协议,RDMA能大幅降低网络通信延迟。阿里云采用软硬一体化的设计思路,将弹性RMDA的加速能力融入公共云,让RDMA从HPC类应用,走向支持通用类计算场景,为微服务、Serverless、服务网格等云原生技术大爆发提供技术支撑。

此外,第四代神龙还大幅提升了基础带宽、块存储、IOPS等核心性能。在深度学习场景下,第四代神龙可提升分布式NLP和视觉计算30%的训练性能;在大数据场景下,可提升Spark30%的计算性能;在数据库场景下,MySQL性能最高提升60%、Redis混合读写吞吐量可提升130%;NginxSSL建连每秒吞吐性能提升420%。

服务器操作系统是基础软件,对于系统整体性能提升至关重要。在今年的大会上,阿里云发布了全新操作系统“龙蜥”并宣布开源。同时,阿里达摩院操作系统实验室也宣告成立。

龙蜥是服务器操作系统,支持X86、ARM等多种芯片架构和计算场景。龙蜥针对云原生应用开发做了多重优化,为云上典型场景带来40%的综合性能提升,故障率降低50%,兼容CentOS生态,支持一键迁移,并提供全栈国密能力。据悉,龙蜥在阿里巴巴内部已经打磨超过10年,有效支撑了历年天猫双11,性能和稳定性都经受住了严苛的考验。

龙蜥操作系统完全开源,通过开源社区和操作系统厂商等形式提供服务。未来,阿里云计划为龙蜥投入20亿专项资金,并联合100家生态合作伙伴推动生态建设,提供至少十年技术支持。

随着智能时代的到来,数据的管理和分析是当下一个普遍需求,也是阿里云的一个技术创新重点。在2021年云栖大会上,阿里云在数据库、大数据和AI应用上都有重要发布。

在数据库方面,阿里云宣布自研云原生关系型数据库PolarDB重磅升级,实现内存池化、多主架构、HTAP实时分析等创新功能。为了更好服务政企市场客户,阿里云还正式发布重磅数据库产品DBStack。它跟强大的阿里云公共云数据库平台能力一脉相承,可以非常敏捷地部署在客户本地IDC或者IaaS平台上,助力金融、政务、运营商、交通等行业客户替换传统商业数据库,加速上云。

在大数据和AI应用方面,阿里云发布了“阿里灵杰”,集成阿里整体大数据+AI能力对外开放,让企业及开发者可“开箱即用”,能更专注于应用开发,能普惠化、插件式的业务交付。

“阿里灵杰”包含机器学习平台PAI、云原生大数据计算服务MaxCompute、实时计算Flink版、大数据开发治理平台DataWorks、实时数仓 Hologres等产品,可调动规模高达10万台以上计算集群,拥有云边端一体的高性能训练和推理引擎,能提供毫秒级延迟的实时数据分析能力等,是中国最大的大数据+AI一体化平台。基于“阿里灵杰”的分布式训练优化技术,达摩院多模态大模型M6已升级至全球首个突破10万亿参数的AI模型,规模超越此前谷歌发布的1.6万亿Switch Transformer模型。

数据中心是耗能大户,随着国家“双碳”战略的推出,数据中心也成为“双碳”达标的关键。作为拥有超过100万台服务器级的云大厂,阿里云一直非常关注数据中心的节能。比如,阿里云工程师们研发出的全浸没式液冷技术,将服务器泡在水里,全程用于散热的能耗几乎为零,节能效果超过70%,实现了数据中心100%无机械制冷。2021年云栖大会上,阿里云宣布将加速在新型数据中心内清洁能源的使用,位于河源的数据中心最快明年将100%使用清洁能源。

在大会的演讲中,阿里云总裁张建锋表示,新型计算体系正在三个层次演进:在基础设施层,将建设云为核心的硬件体系;在核心软件层,将基于云来重构,让云更易用;在应用层,计算和数据加速向云上迁移,催生云电脑、元宇宙、自动驾驶等新物种。

显然,阿里云正按照张建锋的构想在上述三个层面推动云计算产品和技术的创新和进步,加速企业上云,让更多企业更早享受云计算的红利。

来源:至顶网云计算频道

好文章,需要你的鼓励

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

很多人担心被AI取代,陷入无意义感。按照杨元庆的思路,其实无论是模型的打造者,还是模型的使用者,都不该把AI放在人的对立面。

MIT递归语言模型:突破AI上下文限制的新方法

MIT研究团队提出递归语言模型(RLM),通过将长文本存储在外部编程环境中,让AI能够编写代码来探索和分解文本,并递归调用自身处理子任务。该方法成功处理了比传统模型大两个数量级的文本长度,在多项长文本任务上显著优于现有方法,同时保持了相当的成本效率,为AI处理超长文本提供了全新解决方案。

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

谷歌宣布对Gmail进行重大升级,全面集成Gemini AI功能,将其转变为"个人主动式收件箱助手"。新功能包括AI收件箱视图,可按优先级自动分组邮件;"帮我快速了解"功能提供邮件活动摘要;扩展"帮我写邮件"工具至所有用户;支持复杂问题查询如"我的航班何时降落"。部分功能免费提供,高级功能需付费订阅。谷歌强调用户数据安全,邮件内容不会用于训练公共AI模型。

华为研究团队突破代码修复瓶颈,8B模型击败32B巨型对手!

华为研究团队推出SWE-Lego框架,通过混合数据集、改进监督学习和测试时扩展三大创新,让8B参数AI模型在代码自动修复任务上击败32B对手。该系统在SWE-bench Verified测试中达到42.2%成功率,加上扩展技术后提升至49.6%,证明了精巧方法设计胜过简单规模扩展的技术理念。

联想集团混合式AI实践获权威肯定,CES期间获评“全球科技引领企业”

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

CES 2026 | 重大更新:NVIDIA DGX Spark开启“云边端”模式

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

研究发现商业AI模型可完整还原《哈利·波特》原著内容

Razer在2026年CES展会推出全息AI伴侣项目

CES 2026:英伟达新架构亮相,AMD发布新芯片,Razer推出AI奇异产品

通过舞蹈认识LimX Dynamics的人形机器人Oli

谷歌为Gmail搜索引入AI概览功能并推出实验性AI智能收件箱

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

OpenAI推出ChatGPT Health医疗问答功能

Anthropic寻求3500亿美元估值融资100亿美元