Habana Gaudi 加速器首次运用于Amazon EC2云

AWS首席执行官Andy Jassy在2020 re:Invent和AWS最近宣布实例应用的活动上,介绍了创建这一新型训练实例类的初衷:“为终端客户提供比目前这一代基于GPU的实例性价比提升40%的新实例。”

以下详述Gaudi在常用计算机视觉和自然语言处理工作量方面具备的成本效益。

AWS针对EC2 DL1实例以及基于GPU的p4d、p3dn和p3实例发布了DL1按需每小时定价,终端用户可以通过一种简单的方法来自行评估性价比。采用Nvidia在NGC上以及Habana在软件Vault中提供的最新TensorFlow Docker容器,并分别在不同实例上运行这些容器,可比较训练吞吐量和每小时定价。

不同的模型提供的结果不同,而且Gaudi上目前也并非支持所有模型。在本次评估中,我们考虑的是两种常用模型:ResNet-50和BERT-Large。

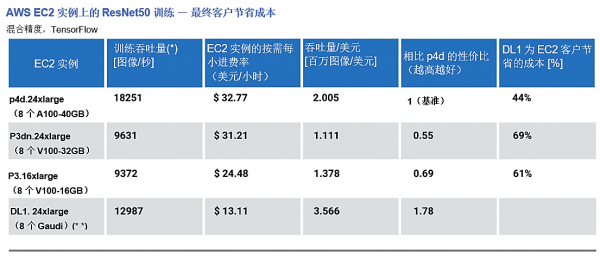

以下表格例举在各种实例类型上训练TensorFlow ResNet-50的训练吞吐量、每小时定价和计算出的吞吐量/美元(即百万张图像/美元)。以p4d.24xlarge实例上设置的性价比为基准,我们可计算出对于此工作量,其他每种实例类型的相对值,以及DL1为目前使用基于GPU实例的EC2终端客户所节省的相应成本百分比。

根据Habana对各种EC2实例的测试结果以及Amazon发布的定价,相比p4d实例,DL1能节省44%的ResNet-50训练成本。对于p3dn最终用户,ResNet-50的训练成本可节省69%。

Habana认识到MLPerf性能基准测试的重要性,用户可以查找在6月份发布的针对8个基于Gaudi的系统进行基准测试的1.0提交结果 - 与DL1.24xlarge非常类似。在此次MLPerf提交结果中,Habana并没有应用数据封装或层融合等额外的软件优化功能来提高性能。我们的目标是提交的结果与参考代码最接近,并能代表客户使用目前的SynapseAI TensorFlow软件可以获得的即时可用性能。因此,客户能轻松对模型进行小幅调整(更改数据、切换层等),同时保持性能相差无几。在TensorFlow上测得的MLPerf TTT结果与早期客户现在看到的训练吞吐量相似。

虽然每个实例的绝对吞吐量有所下降,但基于Gaudi的EC2 DL1定价远低于p4d。这是怎么做到的呢?尽管基于16nm和HBM2的Gaudi封装的晶体管数量不如基于7nm和HBM2e的A100 GPU那么多,但Gaudi的架构以效率为宗旨进行了全新设计,相较于GPU架构,Gaudi架构的资源利用率更高,包含的系统组件更少。结果,系统成本下降,从而为最终用户提供更低价格。

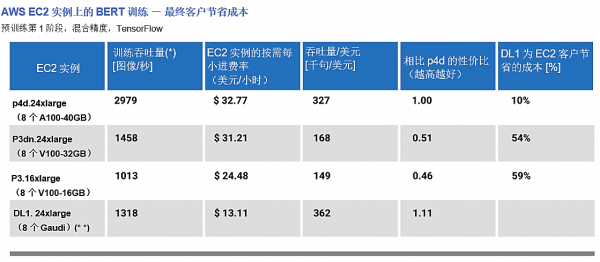

在语言模型中,Gaudi与GPU的性价比提升幅度不如视觉模型,相比p4d,成本节省了10%,相比p3dn,成本节省了54%。BERT-Large是目前常用的一种模型,使用第1阶段中的吞吐量来代表用户可以自行测量的性能。下面是在实际EC2实例上使用Nvidia的NGC中以及Habana的Vault和GitHub中发布的最新即时可用容器和模型超参数针对TensorFlow所测得的结果。

Habana提交的MLPerf BERT结果代表了客户通过目前的SynapseAI® TensorFlow软件可获得的即时可用性能。因此,客户可能轻松对模型进行小幅调整,同时保持性能相差无几。

NVIDIA在MLPerf BERT提交结果中采用了一系列优化功能,这些功能在其已发布的软件中未提供,也很难用于一般用途。例如,他们将整个multi-head attention block融合到单一内核中。如果客户希望对长序列使用不同的attention,他们将不得不更改内核,否则会导致性能下降。NVIDIA还使用了在其标准软件分发中未提供的自定义数据加载技术。

将A100与DL1在NGC提供的最新Tensorflow AMI(基于21.06-tf1-py3 NGC Docker容器)上的BERT性能进行对比,从中可以看出就算是对于BERT也能节省成本。Habana计划下个月向MLPerf提交对BERT实施软件优化后的结果,其中将证明相比5月份的提交结果,性能有显著提高。

Gaudi的价值主张立足于性价比和易用性。Habana提供的架构选项旨在提升效率,不会让终端用户迁移到Gaudi的工作产生困难。

如果您有兴趣了解提前获得Gaudi访问权限的开发人员对Gaudi和DL1的看法,请参阅Habana专题介绍Amazon EC2 DL1实例的产品页面,其中引述了Seagate、Riskfuel、Leidos 等公司相关人员的想法。

“我们预计,搭载Habana Gaudi加速器的Amazon EC2 DL1实例所具备的显著性价比优势,在未来很可能会成为AWS计算集群的有力补充,”Seagate高级分析部运营与技术高级分析工程总监Darrell Louder表示:“随着Habana Labs的不断发展,支持的运营商覆盖范围越来越大,有潜力扩展来支持更多的企业用例,从而进一步节省成本。”

“AI和深度学习是我们机器视觉能力的核心,有助于客户在我们服务的各个行业中做出更好的决策。为了提高准确性,数据集变得越来越大,越来越复杂,因此需要更大、更复杂的模型。这就推动了提高计算性价比的需求,”Fractal集团首席执行官Srikanth Velamakanni说:“与基于GPU的EC2实例相比,新的Amazon EC2 DL1实例承诺能显著降低训练成本。我们预计,对于广泛的客户来说,这一优点将使云端的AI模型训练无论在成本竞争力还是可访问性方面都较以往有大幅提升。”

Leidos卫生与公共服务部首席技术官Chetan Paul表示:“目前我们支持推动医疗保健进步的众多技术中,其中一项技术是使用机器学习和深度学习基于医学成像数据对疾病进行诊断。我们的海量数据集需要及时、高效的训练,为苦心钻研一些最亟待解决的医学谜题的研究人员提供帮助。由于Leidos及其客户需要对深度学习模型进行快速简单而又经济高效的训练,我们很高兴与英特尔和AWS携手,共同踏上基于Habana Gaudi AI处理器的Amazon EC2 DL1实例的发展之旅。使用DL1实例后,我们预计模型训练速度和效率都会有所提升,进而降低研发风险和成本。”

Riskfuel首席执行官Ryan Ferguson表示:“有两个因素吸引我们采用基于Habana Gaudi AI加速器的Amazon EC2 DL1实例。一是我们希望确保银行和保险业客户可以运行利用了最新硬件的Riskfuel模型。幸运的是,我们发现将模型迁移到DL1实例非常简单 — 实际上,只需更改几行代码即可。二是训练成本在我们的支出中占主要部分,高达40%的性价比提升承诺对我们的利润有着潜在的实质性好处。”

如今,我们的参考模型存储库中有20种高需求模型,我们已经制定了路线图,计划对这些模型以及软件功能进行扩展。您也可以在Habana的GitHub上查看对所有人开放的该路线图。

开发者之旅始于SynapseAI SDK。SDK的详细信息在此不再赘述;如果您想了解SDK的更多信息,请查看我们的文档页面。SynapseAI®软件产品组合旨在促进基于Habana Gaudi加速器的高性能深度学习训练。它包括Habana图形编译器和运行时、TPC内核库、固件和驱动程序以及开发人员工具,如用于自定义内核开发的Habana分析器和TPC SDK。

SynapseAI与TensorFlow和PyTorch框架相集成。与Gaudi PyTorch集成相比,TensorFlow集成更加成熟,因为后者的开发时间比前者晚了半年。

因此,相较于Habana在TensorFlow模型的表现,Habana 在PyTorch模型上的性能略低(吞吐量和训练时间)。在SynapseAI用户指南中以及GitHub上的参考模型中记录了已知限制。此外,还在Habana开发人员网站上发布了参考模型的性能结果。Habana团队致力于在后续发行版中不断提升易用性和性能。

我们十分清楚,在进一步开发软件和模型覆盖范围方面还有很多工作要做,将依靠数据研究人员和开发人员来探索Gaudi,并向我们提供相应的反馈和请求。期待通过开发人员站点和GitHub,对于云端(通过 Amazon EC2 DL1 实例)和本地使用Gaudi的问题与DL社区进行互动。

下一步,在软件方面还有很多工作要做,与此同时 — Habana 正在开发下一代Gaudi2 AI处理器,新一代处理器将Gaudi架构从16nm提升到7nm,进一步提高了性价比,造福于终端客户,同时保持相同的架构,并充分利用Gaudi构建的相同SynapseAI软件和生态系统。

目前,Habana团队对通过基于Gaudi的Amazon EC2 DL1实例,为AI提供AWS云中最具成本效益的训练感到满意。

好文章,需要你的鼓励

谷歌免费存储空间调整:未绑定手机号仅享5GB

谷歌近期悄然调整账户存储政策:新注册用户若未绑定手机号,免费存储空间将从原来的15GB缩减至5GB。用户需验证手机号后,方可获得完整的15GB空间,用于Gmail、Drive和Photos的共享使用。谷歌表示,此举旨在确保存储空间"每人仅限一份",有效防止滥用。有分析认为,存储硬件成本上升也是推动此次政策调整的重要原因之一。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

美国三大运营商携手卫星技术,向信号盲区宣战

AT&T、Verizon和T-Mobile宣布计划组建合资企业,利用卫星技术消除美国境内的网络覆盖盲区,重点服务农村及网络欠发达地区。该合资企业将整合知识产权与地面频谱资源,推动下一代直连设备(D2D)通信发展。目前三方尚未签署正式协议,现有运营商与卫星服务协议不受影响。此前,T-Mobile已与SpaceX合作推出星链卫星服务,美国联邦通信委员会也刚批准了价值400亿美元的EchoStar频谱出售案。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

美国三大运营商携手卫星技术,向信号盲区宣战

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

OpenAI再度重组高管架构,全力押注AI智能体战场

出门在外也能用!OpenAI 将 Codex 接入 ChatGPT 移动端

Google Gemini应用图标迎来细微配色调整