实力夺冠!天翼云在国际AI顶会大模型挑战赛中脱颖而出

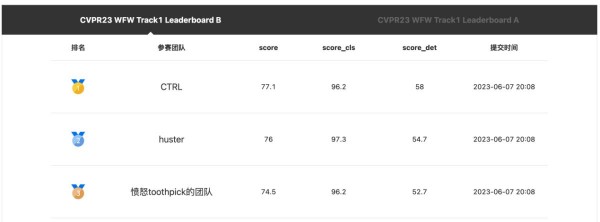

6月7日,国际人工智能顶会CVPR 2023举办的第一届大模型挑战赛(CVPR 2023 Workshop on Foundation Model:1st foundation model challenge)落下帷幕,本次比赛吸引了来自全球著名高校和知名企业的1024名参赛者。经过为期2个月的激烈角逐,天翼云AI团队(队名CTRL)在多任务大模型赛道中表现出色,荣获本届大赛冠军。

CVPR会议是由IEEE主办的关于计算机视觉和模式识别的国际学术会议,收录了该领域最新的研究成果和技术发展,是全球计算机视觉三大顶级会议之一。

传统的视觉模型生产流程通常采用单任务,从零开始训练,各个任务之间无法相互借鉴。由于单任务数据有限,导致模型的实际效果过于依赖任务数据分布,通常对于不同场景的泛化效果不佳。

近年来,大数据预训练技术迅速发展,通过利用大量数据学习通用知识并将其迁移到下游任务中的方法,本质上实现了不同任务之间的相互借鉴。基于海量数据获得的预训练模型具有较好的知识完备性,即使在下游任务中使用少量数据进行微调,仍然能够获得良好的效果。然而,基于预训练+下游任务微调的模型生产流程需要为每个任务单独训练模型,这在研发上消耗了大量资源。相比之下,多任务训练方案通过使用多个任务的数据训练一个功能强大的通用模型,可以直接应用于处理多个任务,从而有效提高模型生产效率和泛化能力。

在本次竞赛中,参赛者需要使用单一模型同时完成交通场景下的分类、检测和分割三个代表性任务的联合训练。天翼云AI团队在模型设计方面凭借丰富的算法开发经验,选择了参数量仅为第2名60%的预训练模型,用更少的参数却获得了更高的精度。

为了解决多任务训练中各分支损失函数和梯度不一致导致收敛缓慢的问题,天翼云AI团队采用了损失均衡和梯度尺度统一的方法,以此来平衡各任务分支的损失函数,并使梯度具有一致的尺度,从而提高模型的训练效率和收敛速度。此外,天翼云AI团队还通过精心设计的任务专属特征金字塔和注意力机制,使各分支任务能够利用骨干网络中对自身任务更有效的特征,进一步提升了整体模型的精度和性能。

通过以上模型设计和训练策略,天翼云AI团队在竞赛中取得了优异成绩,充分展示了在图像、音频及多模态领域的深厚积累和持续创新能力。未来,天翼云将继续在广阔的人工智能领域进行创新和探索,以更先进的技术和卓越的成果惠及更多用户,为千行百业的数字化发展提供支撑。

来源:业界供稿

好文章,需要你的鼓励

谷歌免费存储空间调整:未绑定手机号仅享5GB

谷歌近期悄然调整账户存储政策:新注册用户若未绑定手机号,免费存储空间将从原来的15GB缩减至5GB。用户需验证手机号后,方可获得完整的15GB空间,用于Gmail、Drive和Photos的共享使用。谷歌表示,此举旨在确保存储空间"每人仅限一份",有效防止滥用。有分析认为,存储硬件成本上升也是推动此次政策调整的重要原因之一。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

美国三大运营商携手卫星技术,向信号盲区宣战

AT&T、Verizon和T-Mobile宣布计划组建合资企业,利用卫星技术消除美国境内的网络覆盖盲区,重点服务农村及网络欠发达地区。该合资企业将整合知识产权与地面频谱资源,推动下一代直连设备(D2D)通信发展。目前三方尚未签署正式协议,现有运营商与卫星服务协议不受影响。此前,T-Mobile已与SpaceX合作推出星链卫星服务,美国联邦通信委员会也刚批准了价值400亿美元的EchoStar频谱出售案。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

美国三大运营商携手卫星技术,向信号盲区宣战

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

OpenAI再度重组高管架构,全力押注AI智能体战场

出门在外也能用!OpenAI 将 Codex 接入 ChatGPT 移动端

Google Gemini应用图标迎来细微配色调整